Scrapling:让网络爬虫变得轻松、高效且智能

你是否曾因网站反爬机制而头疼,或因网站结构更新导致辛苦编写的爬虫脚本失效?Scrapling 的出现,旨在彻底解决这些问题。它是一个功能强大、灵活且高性能的 Python 网络爬虫库,旨在让数据抓取变得前所未有的简单和智能。本文将带你全面了解这个潜力新星。

截至收录:

Scrapling项目stars数:8799

Scrapling项目forks数:534

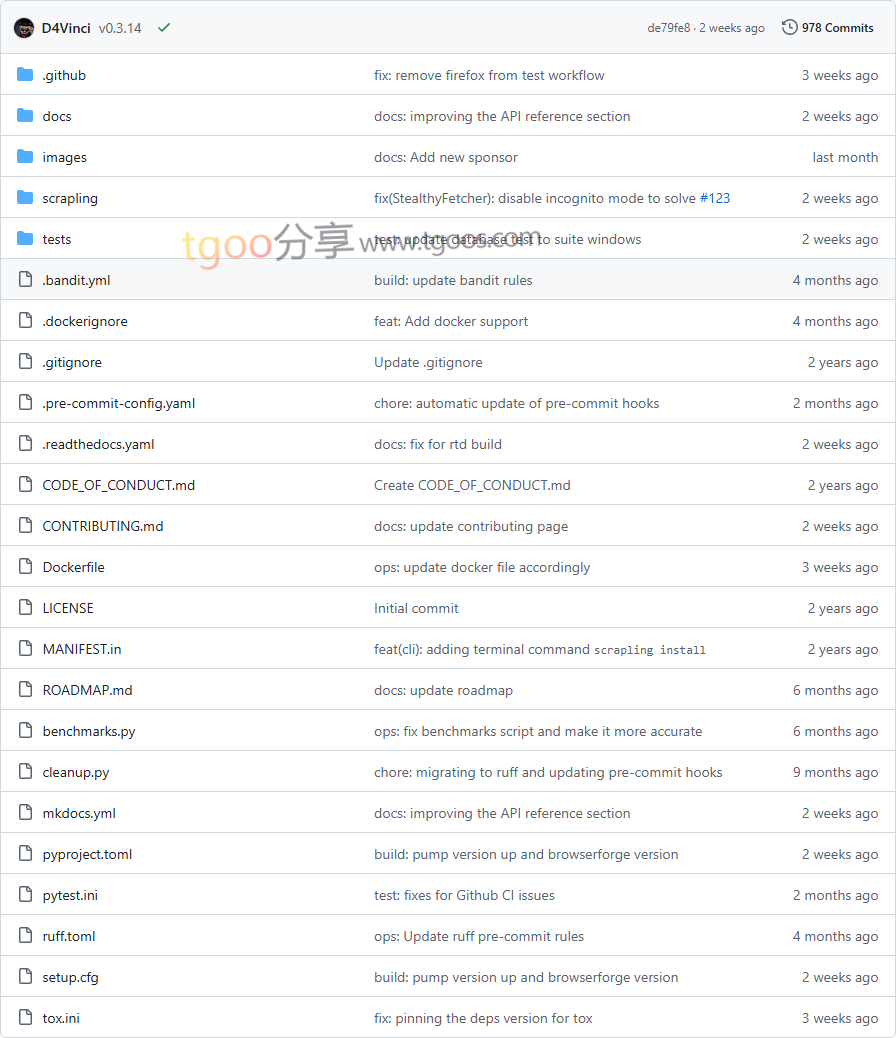

Scrapling项目目录截图

Scrapling项目核心亮点

- 🤖 自适应智能爬取:核心创新功能。当网站结构更新时,Scrapling 能利用智能相似性算法自动重新定位目标元素,让你的爬虫脚本“永不失效”。

- 🛡️ 强大的反爬绕过能力:内置

StealthyFetcher,可模拟浏览器 TLS 指纹、请求头,并支持自动化绕过 Cloudflare 等各类验证码和反爬墙。 - 🚀 极致性能与丰富选择器:拥有优化的解析引擎,性能远超多数 Python 爬虫库。同时支持 CSS 选择器、XPath、文本搜索、正则搜索等多种元素定位方式。

- 🔌 开发者友好体验:提供交互式爬虫 Shell、命令行工具、完整的类型提示、熟悉的 API(类似 Scrapy/BeautifulSoup)以及内置的 MCP 服务器,方便与 AI 助手(如 Claude、Cursor)集成进行智能数据提取。

Scrapling项目快速开始

只需几步,你就能开始使用 Scrapling:

安装:

# 基础安装(仅包含解析引擎)

$ pip install scrapling

# 安装完整功能(包含所有抓取器、浏览器依赖等)

$ pip install "scrapling[all]"

$ scrapling install # 下载并安装浏览器依赖

运行你的第一个爬虫:

from scrapling.fetchers import Fetcher

# 一个简单的 HTTP 请求示例

page = Fetcher.get( https://quotes.toscrape.com/ ) quotes = page.css( .quote .text::text ) for quote in quotes: print(quote.get())

体验命令行工具:

# 启动交互式爬虫 Shell

$ scrapling shell

# 直接从命令行提取网页内容到文件

$ scrapling extract get https://example.com content.txtScrapling项目应用场景

- 数据聚合与分析:从多个电商网站、新闻门户或社交媒体平台稳定、高效地抓取价格、新闻、评论等数据,用于市场分析或研究。

- 自动化测试与监控:模拟真实用户行为,对动态加载的网页进行功能测试,或定期监控竞争对手网站的内容更新。

- AI 辅助的数据提取:利用内置的 MCP 服务器,让 AI 助手理解网页结构并精确提取非结构化数据,极大提升信息处理效率。

- 研究与教育:在遵守法律法规和网站协议的前提下,用于学术研究、价格追踪、舆情监控等合规的数据收集任务。

Scrapling项目链接

D4Vinci / Scrapling项目地址:https://github.com/D4Vinci/Scrapling

本文地址:https://www.tgoos.com/34808

声明:本站资源均整理自互联网,版权归原作者所有,仅供学习交流使用,请勿直接商用,若需商用请购买正版授权。因违规使用产生的版权及法律责任由使用者自负。部分资源可能包含水印或引流信息,请自行甄别。若链接失效可联系站长尝试补链。若侵犯您的权益,请邮件(将 # 替换为 @)至 feedback#tgoos.com,我们将及时处理删除。转载请保留原文链接,感谢支持原创。