ChatMLX:在 Apple 芯片上本地运行大语言模型的聊天应用

你是否渴望一个既保护隐私,又能充分利用 Mac 强大性能的 AI 聊天助手?ChatMLX 的出现,旨在彻底解决这个问题。它是一个基于 MLX 框架和 Apple Silicon 芯片优化的开源、高性能 macOS 聊天应用,可以让开发者和普通用户在本地安全、流畅地运行多种大语言模型。本文将带你全面了解这个为 Mac 用户量身打造的 AI 新星。

截至收录:

ChatMLX项目stars数:813

ChatMLX项目forks数:61

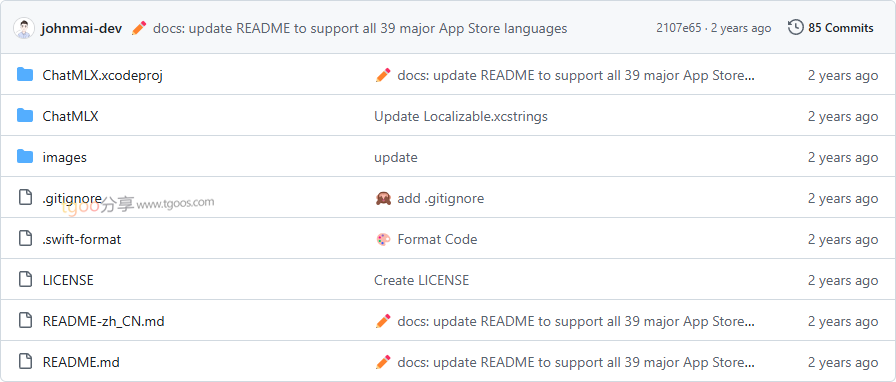

ChatMLX项目目录截图

ChatMLX项目核心亮点

- 🍎 原生 Apple Silicon 优化:深度集成 MLX 框架,专为 M 系列芯片优化,实现极致的本地运行性能与能效比。

- 🔒 隐私与安全至上:所有模型均在本地运行,对话数据完全存储在用户设备上,无需担心云端隐私泄露风险。

- 🌐 多模型支持:内置对 Llama、OpenELM、Phi、Qwen、Gemma 等多种主流开源大语言模型的支持,提供丰富的对话选择。

- 🗣️ 国际化界面:支持包括英文、简体中文、繁体中文、日文、韩文在内的 39 种 App Store 主要语言,为全球用户提供便利。

ChatMLX项目快速开始

只需几步,你就能在 Mac 上体验本地 AI 对话:

1. 下载与安装:

* 访问项目的 GitHub Release 页面,下载最新的 .dmg 安装包。

* 将 ChatMLX.app 拖拽到“应用程序”文件夹中。

- 解决安全提示(首次运行):

由于应用未经过 Apple 公证,首次打开时可能会遇到安全阻拦。在终端中执行以下命令即可解决:sudo xattr -d com.apple.quarantine /Applications/ChatMLX.app或者使用清除扩展属性的命令:

xattr -c /Applications/ChatMLX.app/* - 启动与使用:

- 从“应用程序”文件夹中打开 ChatMLX。

- 在应用内选择或下载你偏好的大语言模型。

- 开始你的本地、私密、高性能的 AI 对话。

ChatMLX项目应用场景

- 隐私敏感型对话:处理涉及个人创意、商业机密或敏感信息的对话,确保数据不出本地。

- 离线环境开发与学习:程序员、学生或研究人员在无网络环境下,依然可以使用大模型进行代码辅助、问题解答和知识查询。

- 多语言内容创作:利用其多语言模型支持,进行翻译、润色或不同语言的内容生成工作。

- 探索与比较不同模型:开发者或 AI 爱好者可以方便地在同一界面下测试和比较不同开源 LLM 的性能与特点。

ChatMLX项目链接

johnmai-dev / ChatMLX项目地址:https://github.com/johnmai-dev/ChatMLX

本文地址:https://www.tgoos.com/37856

声明:本站资源均整理自互联网,版权归原作者所有,仅供学习交流使用,请勿直接商用,若需商用请购买正版授权。因违规使用产生的版权及法律责任由使用者自负。部分资源可能包含水印或引流信息,请自行甄别。若链接失效可联系站长尝试补链。若侵犯您的权益,请邮件(将 # 替换为 @)至 feedback#tgoos.com,我们将及时处理删除。转载请保留原文链接,感谢支持原创。