Kotaemon:开源RAG工具,让文档对话触手可及

你是否曾经在处理大量文档时,希望能够像与人对话一样快速获取精准信息?Kotaemon 的出现,旨在彻底解决这个问题。它是一个基于 RAG(检索增强生成)技术的开源文档对话工具,可以帮助开发者和终端用户轻松构建与文档智能交互的问答系统。本文将带你全面了解这个潜力新星。

截至收录:

Kotaemon项目stars数:23590

Kotaemon项目forks数:1925

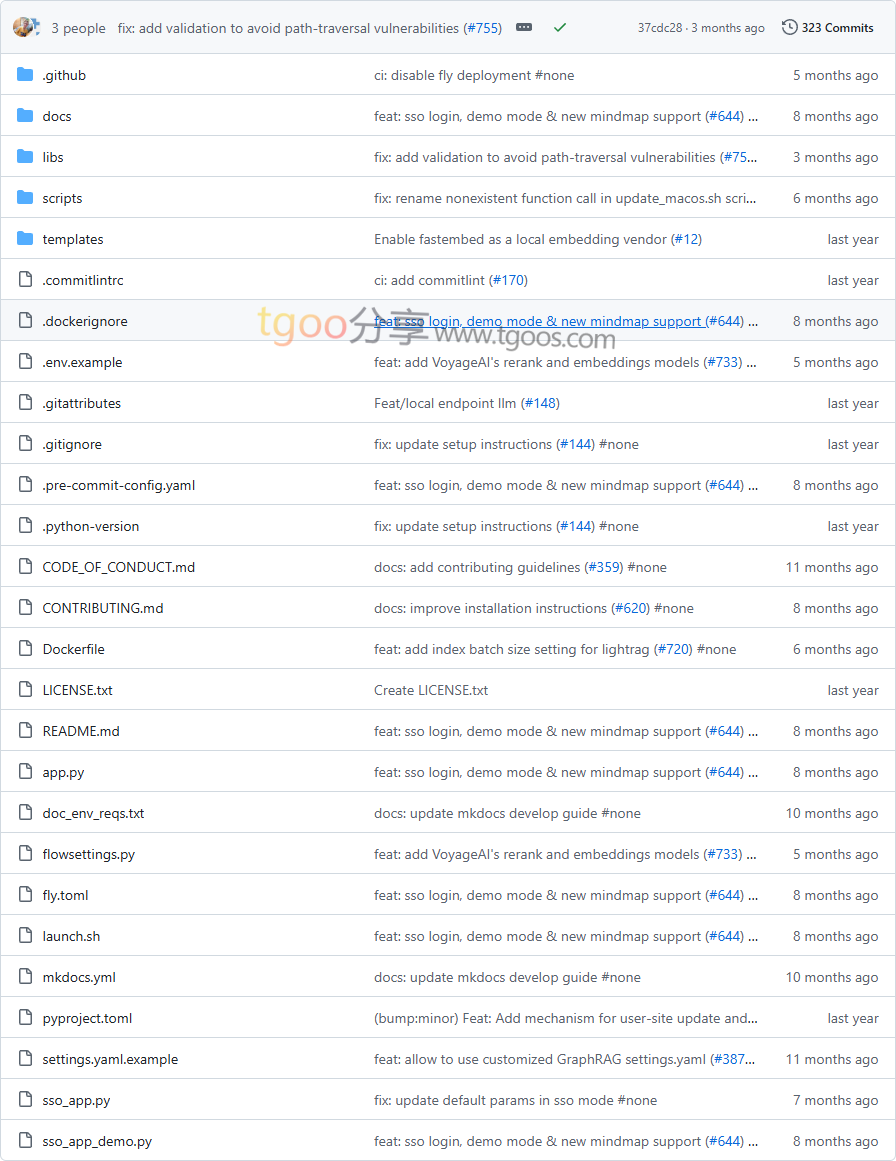

Kotaemon项目目录截图

Kotaemon核心亮点

🌟 开箱即用的RAG UI:提供简洁直观的用户界面,支持多用户登录、文件管理及协作分享,让文档问答变得轻松高效。

🎯 多模态与多模型支持:兼容主流LLM API(如OpenAI、Azure)和本地模型(如Ollama),支持含图表的多模态文档解析与问答。

🔒 混合检索与重排序机制:结合全文检索与向量检索,配合重排序技术,显著提升信息检索的准确性与相关性。

🧩 高度可定制化:基于Gradio构建,支持UI自定义、推理流程调整,并可扩展多种检索与索引策略(如GraphRAG)。

Kotaemon快速开始

只需几步,你就能在本地运行起 Kotaemon:

- 使用Docker快速部署(推荐):

docker run -e GRADIO_SERVER_NAME=0.0.0.0 -e GRADIO_SERVER_PORT=7860 -v ./ktem_app_data:/app/ktem_app_data -p 7860:7860 -it --rm ghcr.io/cinnamon/kotaemon:main-lite - 访问Web界面:

部署完成后,在浏览器中打开http://localhost:7860/,使用默认账号(用户名/密码均为admin)登录。 - 配置模型与文档:

在“Resources”和“LLMs and Embeddings”选项卡中设置API密钥,上传文档即可开始问答。

Kotaemon应用场景

场景一:企业知识库问答:内部团队可快速搭建私有知识库,实现对政策、手册、技术文档的智能检索与问答,提升信息获取效率。

场景二:学术研究与资料分析:研究者可上传论文、报告,通过多模态解析(图表、表格)进行深入问答与内容挖掘。

场景三:开发测试与原型构建:开发者基于Kotaemon框架定制RAG流程,集成自有模型与检索逻辑,加速AI应用开发。

用户案例:目前,多家科技企业及研究机构已在内部部署Kotaemon,用于构建智能客服、文档助手等场景应用。

Kotaemon项目链接

Cinnamon / kotaemon项目地址:https://github.com/Cinnamon/kotaemon

本文地址:https://www.tgoos.com/9803