ml-stable-diffusion:在苹果芯片上运行Stable Diffusion的Core ML解决方案

你是否曾经希望在苹果设备上高效运行Stable Diffusion模型,却受限于性能和兼容性问题?ml-stable-diffusion的出现,旨在彻底解决这个问题。它是一个由苹果官方提供的开源工具集,可以帮助开发者在Apple Silicon设备上无缝部署和运行Stable Diffusion模型。本文将带你全面了解这个专为苹果生态打造的AI图像生成方案。

截至收录:

ml-stable-diffusion stars数:17697

ml-stable-diffusion forks数:1032

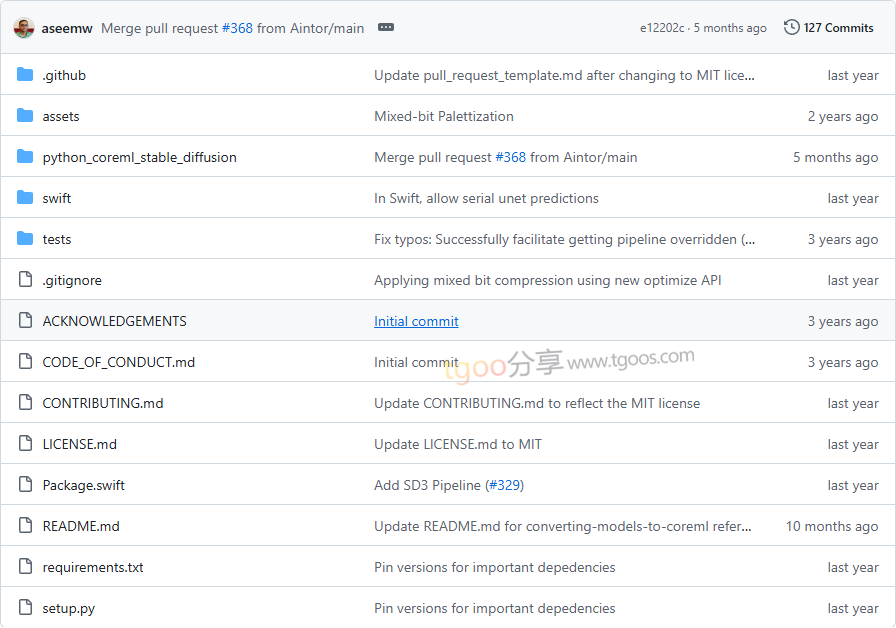

ml-stable-diffusion项目目录截图

ml-stable-diffusion核心亮点

🚀 原生苹果生态集成:专为Apple Silicon优化,充分利用神经引擎(Neural Engine)和GPU加速,提供卓越的推理性能。

🔄 双语言支持:提供Python包用于模型转换,Swift包用于应用集成,覆盖从开发到部署的全流程。

📱 移动端部署:支持在iPhone、iPad和Mac上本地运行Stable Diffusion,无需云端服务,保护用户隐私。

🎯 模型兼容性广:支持Stable Diffusion 3、Stable Diffusion XL、ControlNet等多种模型变体,满足不同应用需求。

ml-stable-diffusion快速开始

只需几步,你就能在苹果设备上运行Stable Diffusion:

- 安装Python包:

pip install apple-coreml-stable-diffusion - 转换PyTorch模型到Core ML格式:

python -m python_coreml_stable_diffusion.torch2coreml --convert-unet --convert-vae-decoder --convert-text-encoder --model-version stabilityai/stable-diffusion-2-base - 在Swift项目中使用:

import StableDiffusion let pipeline = try StableDiffusionPipeline(resourcesAt: modelURL) let images = try pipeline.generateImages(prompt: "a photo of an astronaut riding a horse on mars")

ml-stable-diffusion应用场景

移动端创意应用:开发者可以构建直接在iPhone或iPad上运行的AI绘画应用,用户无需联网即可生成高质量图像。

隐私保护场景:所有图像生成都在设备本地完成,敏感数据不会上传到云端,适合医疗、金融等对隐私要求严格的领域。

原型快速开发:研究人员和开发者可以快速在苹果设备上测试和演示Stable Diffusion模型,加速产品迭代。

教育学习工具:学生和AI爱好者可以在个人设备上学习和实验扩散模型,降低学习门槛。

ml-stable-diffusion链接

apple / ml-stable-diffusion项目地址:https://github.com/apple/ml-stable-diffusion

本文地址:https://www.tgoos.com/29891