AIKit:一站式开源大语言模型部署、微调与分发平台

你是否曾为部署和微调开源大语言模型(LLM)的复杂环境、繁琐配置和资源要求而感到头疼?AIKit 的出现,旨在彻底解决这个问题。它是一个基于容器的综合平台,可以帮助开发者与研究者轻松完成大语言模型的托管、部署、构建和微调,实现开箱即用的 LLM 应用体验。

截至收录:

AIKit项目stars数:505

AIKit项目forks数:55

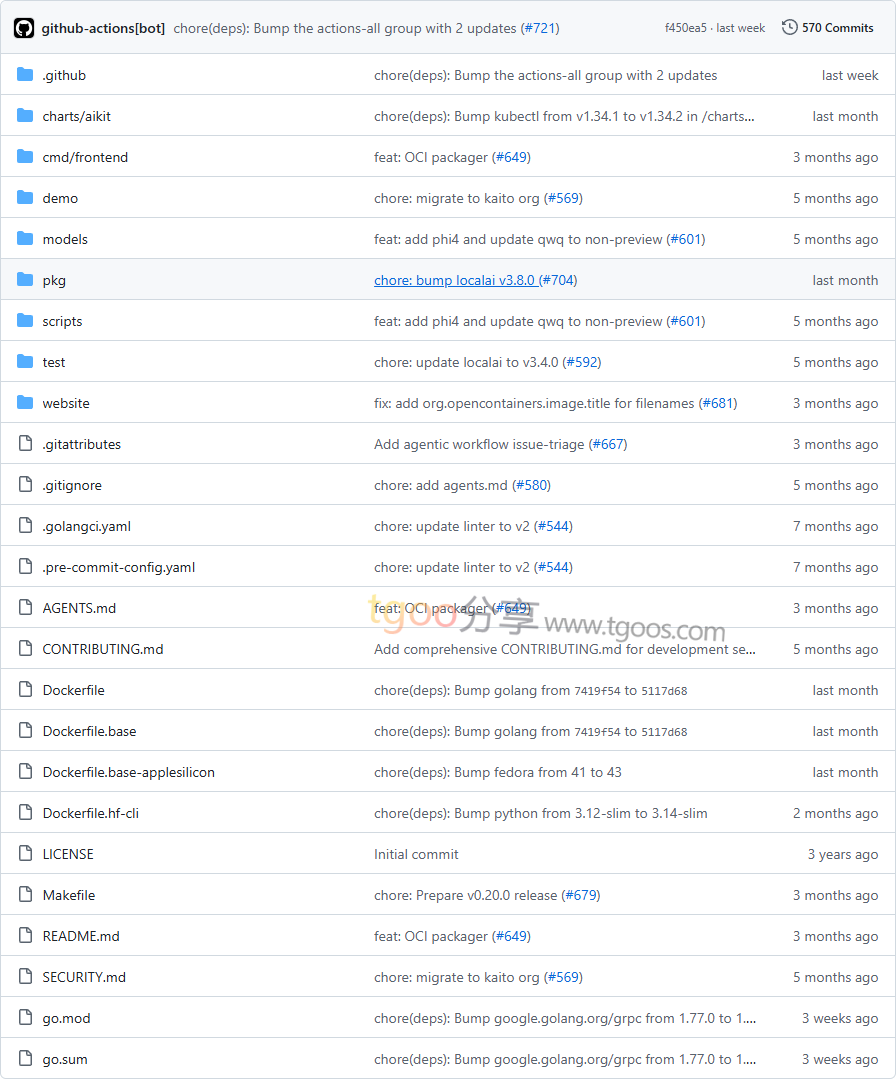

AIKit项目目录截图

AIKit项目核心亮点

- 🐳 极简部署,开箱即用:仅需 Docker 或 Podman,无需 GPU、互联网访问或其他复杂工具,即可在本地快速启动一个功能完整的 LLM 服务。

- ✨ 完全兼容 OpenAI API:底层采用 LocalAI,提供与 OpenAI API 完全兼容的 REST API。这意味着你可以无缝使用任何 OpenAI 客户端(如 Kubectl AI、Chatbot-UI)来调用开源模型。

- 🎵 高效便捷的微调支持:内置可扩展的微调接口,并集成了 Unsloth 框架,提供快速、内存高效且易于使用的模型微调体验。

- 📦 现代化的模型分发:支持将模型打包为标准 OCI 镜像,通过任何 OCI 兼容的仓库(如 Docker Hub、GHCR)进行分发和管理,符合 CNCF ModelPack 规范,便于团队协作和供应链安全。

AIKit项目快速开始

只需一条命令,你就能在本地运行起一个强大的 Llama 3.1 模型服务:

1. 启动模型服务:

bash

docker run -d --rm -p 8080:8080 ghcr.io/kaito-project/aikit/llama3.1:8b

2. 访问 Web 界面:

在浏览器中打开 http://localhost:8080/chat,即可开始对话。

3. 通过 API 调用:

使用任何兼容 OpenAI 的客户端或直接通过 curl 进行调用:

bash

curl http://localhost:8080/v1/chat/completions -H "Content-Type: application/json" -d {

"model": "llama-3.1-8b-instruct",

"messages": [{"role": "user", "content": "请用一句话解释 Kubernetes"}]

}

AIKit项目应用场景

- 本地开发与原型验证:开发者可以在无 GPU 的本地环境中,快速搭建和测试基于开源 LLM 的应用原型,加速产品迭代。

- 私有化模型部署与微调:企业或研究机构可以在内网或隔离环境中,安全地部署模型,并利用自有数据对模型进行定制化微调,满足特定业务需求。

- 模型的分发与供应链管理:团队可以将训练好的模型打包成 OCI 镜像,通过内部镜像仓库统一管理、版本控制和分发,确保模型部署的一致性和可追溯性。

- 跨架构与边缘计算:支持 AMD64、ARM64 CPU 以及 NVIDIA GPU 和 Apple Silicon,使得模型可以灵活部署在从云端服务器到边缘设备的各种环境中。

AIKit项目链接

kaito-project / aikit项目地址:https://github.com/kaito-project/aikit

本文地址:https://www.tgoos.com/39456

声明:本站资源均整理自互联网,版权归原作者所有,仅供学习交流使用,请勿直接商用,若需商用请购买正版授权。因违规使用产生的版权及法律责任由使用者自负。部分资源可能包含水印或引流信息,请自行甄别。若链接失效可联系站长尝试补链。若侵犯您的权益,请邮件(将 # 替换为 @)至 feedback#tgoos.com,我们将及时处理删除。转载请保留原文链接,感谢支持原创。