CocoIndex:面向AI的超高性能数据转换框架

你是否曾为构建AI应用时复杂、低效且难以维护的数据处理流水线而头疼?CocoIndex 的出现,旨在彻底解决这个问题。它是一个用 Rust 编写核心引擎的超高性能数据转换框架,专为 AI 场景设计,原生支持增量处理和血缘追踪,旨在让开发者以极致的速度构建生产就绪的数据索引流程。本文将带你全面了解这个潜力新星。

截至收录:

CocoIndex项目stars数:5869

CocoIndex项目forks数:431

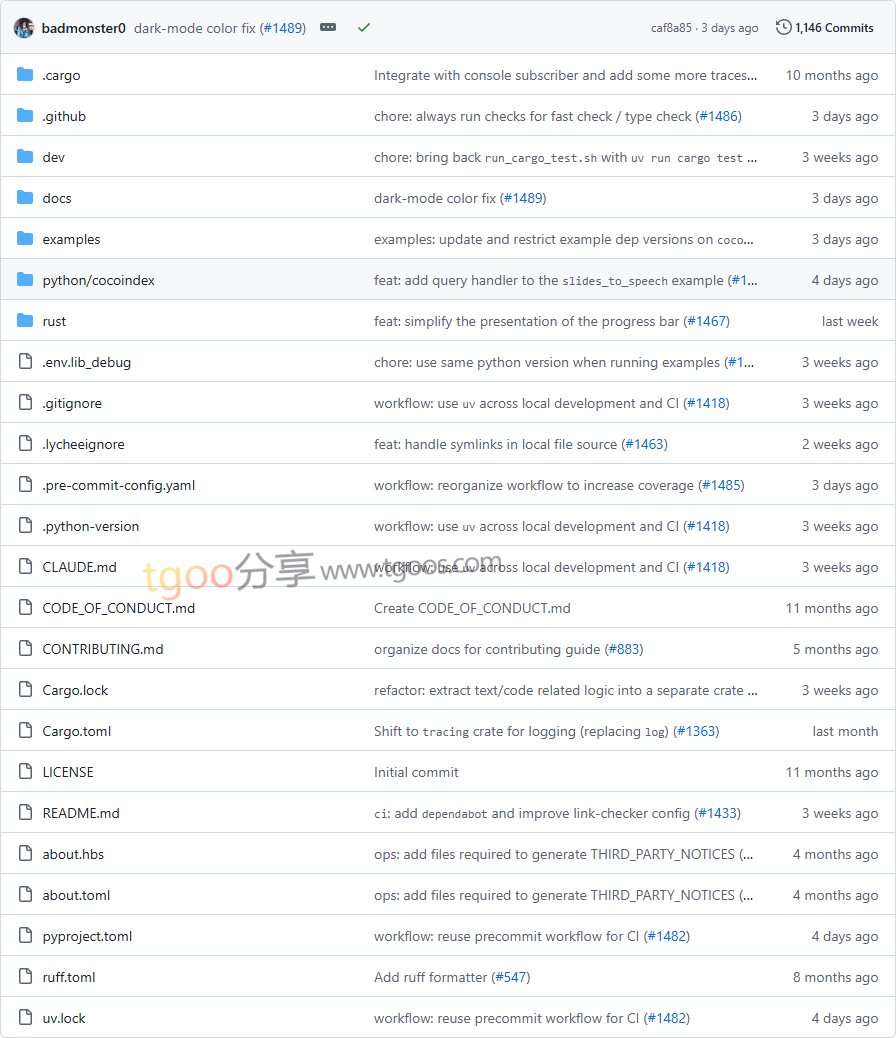

CocoIndex项目目录截图

CocoIndex项目核心亮点

- 🚀 极致性能:核心引擎采用 Rust 编写,提供超高性能的数据处理能力,为大规模 AI 数据转换任务而生。

- 🔄 增量处理:开箱即用的增量索引支持,当数据源或处理逻辑变更时,仅重新计算必要的部分,最大化利用缓存,显著提升效率。

- 📊 数据血缘与可观测性:基于数据流编程模型,每次转换都创建新字段,无隐藏状态和值突变。所有转换前后的数据均可观测,并自动提供完整的数据血缘关系。

- 🧩 即插即用:为不同数据源、目标和转换功能提供了丰富的原生内置模块。标准化接口使得在不同组件间切换仅需一行代码,如同搭积木般简单。

CocoIndex项目快速开始

只需几步,你就能开始使用 CocoIndex 构建你的第一个数据索引流程:

- 安装:

bash

# 安装 CocoIndex Python 库

$ pip install -U cocoindex

(可选)安装 PostgreSQL 用于增量处理。 - 定义你的第一个数据流:

创建一个 Python 文件(例如my_flow.py),并定义一个简单的文本嵌入流程:

“`python

import cocoindex@cocoindex.flow_def(name=”TextEmbedding”)

def text_embedding_flow(flow_builder: cocoindex.FlowBuilder, data_scope: cocoindex.DataScope):

# 1. 添加数据源:读取本地 Markdown 文件

data_scope[“documents”] = flow_builder.add_source(cocoindex.sources.LocalFile(path=”markdown_files”))# 2. 添加数据收集器,用于导出到向量数据库 doc_embeddings = data_scope.add_collector() # 3. 转换每个文档 with data_scope["documents"].row() as doc: # 分割文档为块 doc["chunks"] = doc["content"].transform( cocoindex.functions.SplitRecursively(), language="markdown", chunk_size=2000, chunk_overlap=500) # 转换每个块 with doc["chunks"].row() as chunk: # 为文本块生成嵌入向量 chunk["embedding"] = chunk["text"].transform( cocoindex.functions.SentenceTransformerEmbed( model="sentence-transformers/all-MiniLM-L6-v2")) # 收集数据 doc_embeddings.collect(filename=doc["filename"], location=chunk["location"], text=chunk["text"], embedding=chunk["embedding"]) # 4. 导出到 PostgreSQL 向量索引 doc_embeddings.export( "doc_embeddings", cocoindex.targets.Postgres(), primary_key_fields=["filename", "location"], vector_indexes=[ cocoindex.VectorIndexDef( field_name="embedding", metric=cocoindex.VectorSimilarityMetric.COSINE_SIMILARITY)])“`

CocoIndex项目应用场景

- 构建向量搜索索引:轻松处理文本文档、PDF、代码或图像,生成嵌入向量并同步至 Qdrant、LanceDB、PostgreSQL 等向量数据库,实现语义搜索。

- 知识图谱构建:从会议记录、文档中利用 LLM 提取结构化信息和关系,自动构建和同步知识图谱。

- 多模态数据处理:同时处理 PDF 中的文本和图像,分别使用 SentenceTransformer 和 CLIP 模型生成嵌入,实现跨模态检索。

- 实时数据管道:对接 Amazon S3、Azure Blob、Google Drive 等云存储,建立能自动感知源数据变化并增量更新的实时数据处理管道。

- 复杂信息提取:利用 LLM(配合 BAML、DSPy 等框架)从非结构化表单(如患者入院表)或网页内容(如 HackerNews)中提取标准化数据。

用户案例:项目提供了超过 20 个开箱即用的示例,涵盖了从简单的文本嵌入到复杂的多模态知识图谱构建,展示了其在生产环境中的强大能力。

CocoIndex项目链接

cocoindex-io / cocoindex项目地址:https://github.com/cocoindex-io/cocoindex

本文地址:https://www.tgoos.com/39321

声明:本站资源均整理自互联网,版权归原作者所有,仅供学习交流使用,请勿直接商用,若需商用请购买正版授权。因违规使用产生的版权及法律责任由使用者自负。部分资源可能包含水印或引流信息,请自行甄别。若链接失效可联系站长尝试补链。若侵犯您的权益,请邮件(将 # 替换为 @)至 feedback#tgoos.com,我们将及时处理删除。转载请保留原文链接,感谢支持原创。