GLM-4:开源多语言多模态对话模型系列

你是否曾经为寻找一个性能强大、易于部署且功能全面的开源大语言模型而烦恼?GLM-4 系列模型的出现,旨在彻底解决这个问题。它是一个由智谱AI开源的、包含多种参数规模和能力侧重的多语言多模态对话模型家族,可以帮助开发者和研究者在代码生成、复杂推理、多轮对话、视觉理解等场景中获得媲美顶尖商业模型的能力。本文将带你全面了解这个潜力新星。

截至收录:

GLM-4项目stars数:7040

GLM-4项目forks数:606

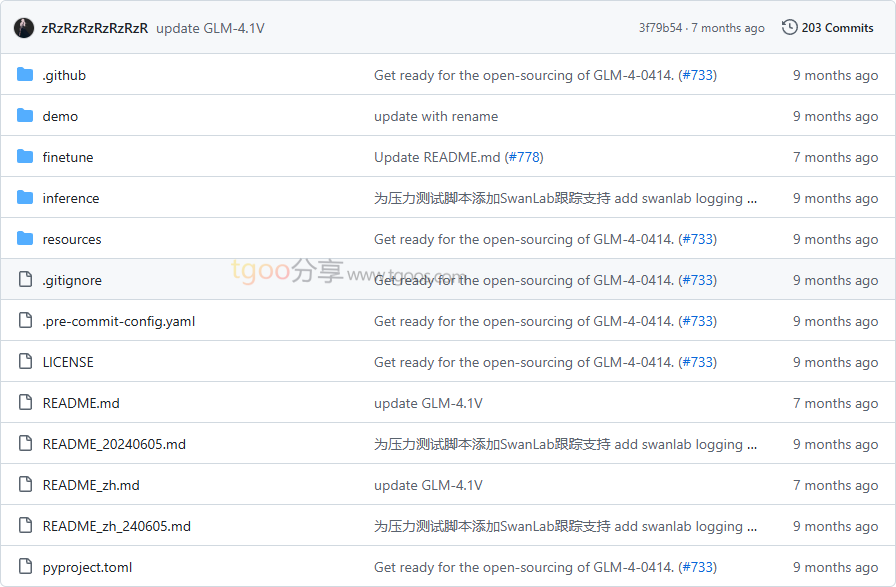

GLM-4项目目录截图

GLM-4项目核心亮点

🌟 亮点一:媲美顶尖模型的性能:GLM-4-32B-0414 在多项基准测试(如代码生成、指令遵循、复杂问答)中表现优异,其性能与 OpenAI 的 GPT 系列及 DeepSeek 的 V3/R1 系列等顶级模型相当,为开源社区提供了强大的替代选择。

🎯 亮点二:丰富的模型矩阵:提供从 9B 到 32B 不同参数规模的模型,涵盖基础版、对话版、深度推理版和沉思版,满足从轻量级部署到复杂任务处理的不同需求,特别是 GLM-Z1-9B-0414 在小型模型中实现了卓越的效能平衡。

🔒 亮点三:强大的智能体与工具调用能力:模型在训练中强化了指令遵循、工程代码和函数调用等原子能力,支持与搜索工具结合,能够胜任基于搜索的问答、报告生成等智能体任务,具备实际应用潜力。

🧩 亮点四:便捷的本地化部署与微调:提供完善的 transformers、vLLM、llama.cpp 等主流框架支持,并附带详细的微调指南和脚本,支持 LoRA 等高效微调方法,方便研究者和开发者进行定制化开发。

GLM-4项目快速开始

只需几步,你就能使用 transformers 库快速体验 GLM-4 的对话能力:

1. 安装环境:

bash

# 安装 transformers 及相关依赖

$ pip install transformers torch

- 运行你的第一个对话:

“`python

from transformers import AutoTokenizer, AutoModelForCausalLM

import torchmodel_path = “THUDM/GLM-4-9B-0414″ # 也可替换为其他模型,如 GLM-4-32B-0414

tokenizer = AutoTokenizer.from_pretrained(model_path, trust_remote_code=True)

model = AutoModelForCausalLM.from_pretrained(

model_path,

torch_dtype=torch.bfloat16, # 根据你的硬件调整精度

device_map=”auto”,

trust_remote_code=True

).eval()messages = [{“role”: “user”, “content”: “你好,请介绍一下你自己。”}]

response, history = model.chat(tokenizer, messages, history=[])

print(response)

``finetune/` 目录提供了完整的微调脚本和示例,帮助你快速启动模型定制。

3. **查看微调示例**:

项目仓库中的

GLM-4项目应用场景

场景一:代码生成与辅助编程:开发者可以利用 GLM-4 强大的代码能力,生成函数片段、调试代码、甚至根据自然语言描述创建完整的网页或动画程序(如项目展示中的旋转六边形小球动画)。

场景二:复杂研究与分析报告撰写:研究人员或分析师可以使用具备“沉思”能力的 GLM-Z1-Rumination 模型,结合搜索工具,进行深度信息检索、多角度分析和长篇研究报告的撰写。

场景三:多轮对话与智能客服:GLM-4 的对话模型经过精心对齐,能够进行流畅、连贯的多轮对话,适用于构建智能客服、虚拟助手等应用。

场景四:多模态内容理解与生成:GLM-4V 系列模型支持视觉输入,可以用于图像描述、视觉问答、基于图文内容的创意生成等任务。

用户案例:作为智谱AI核心的开放模型系列,GLM-4 已被广泛应用于学术研究、企业级应用开发以及众多AI创业项目中,其开源特性极大地推动了AI技术的普及和创新。

GLM-4项目链接

zai-org / GLM-4项目地址:https://github.com/zai-org/GLM-4

本文地址:https://www.tgoos.com/39652