VibeVoice:开源前沿语音AI,重塑长对话语音合成

你是否曾为传统语音合成系统在生成长篇、多角色对话时缺乏自然度和一致性而烦恼?VibeVoice 的出现,旨在彻底解决这个问题。它是一个由微软开源的研究框架,基于创新的连续语音分词器和下一代扩散模型,能够生成富有表现力的长篇、多说话人对话音频。本文将带你全面了解这个语音AI领域的潜力新星。

截至收录:

VibeVoice项目stars数:20361

VibeVoice项目forks数:2255

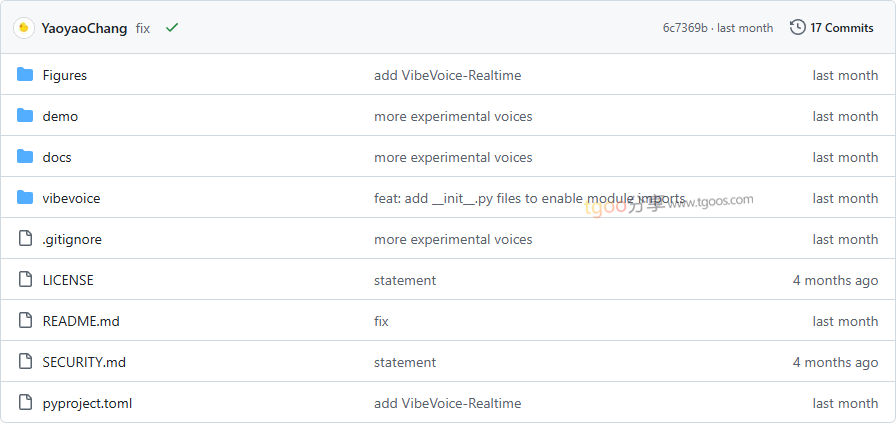

VibeVoice项目目录截图

VibeVoice项目核心亮点

🌟 创新架构:采用7.5Hz超低帧率的连续语音分词器(声学与语义),结合LLM理解文本与扩散模型生成细节,在保证音质的同时极大提升了长序列处理的计算效率。

🎯 支持长篇幅与多说话人:可合成长达90分钟的单人或对话语音,并支持最多4个不同的说话人,突破了此前模型通常1-2人的限制。

⚡ 实时流式TTS:提供专门的实时流式文本转语音模型,首段语音生成延迟约300毫秒,支持流式文本输入,为低延迟应用场景设计。

🌍 多语言与风格探索:持续增加实验性说话人,目前已支持包括中文、英文及德、法、日、韩等九种语言,并提供多种英文风格语音,拓展了应用边界。

VibeVoice项目快速开始

你可以通过官方提供的Colab笔记本快速体验VibeVoice的能力:

1. 访问Colab:

打开 VibeVoice-Realtime Colab示例(需科学上网)。

2. 运行代码单元:

在Colab环境中,按照笔记本中的说明依次运行代码单元,即可体验实时语音合成。

3. 本地部署与WebSocket示例:

克隆项目仓库,并参考 usage 目录下的WebSocket示例,启动你自己的实时演示服务。

$ git clone https://github.com/microsoft/VibeVoice.git

# 随后按照项目文档配置环境并运行示例VibeVoice项目应用场景

场景一:内容创作与播客生成:创作者或制作人可以使用它,将剧本或对话文本快速转换为具有多个角色、自然交替的长篇播客或有声剧音频。

场景二:实时交互与辅助工具:集成到需要实时语音反馈的应用中,如高级语音助手、实时解说或无障碍阅读工具,提供低延迟、高质量的语音输出。

场景三:语音研究与算法开发:为学术界和工业界的研究人员提供一个强大的开源平台,用于探索前沿的语音合成技术、长上下文建模以及多说话人生成。

用户案例:作为一个前沿的研究框架,VibeVoice 主要服务于AI研究社区和开发者。其演示视频与Wan2.2等团队的协作,也展示了在跨模态内容生成领域的潜在应用价值。

VibeVoice项目链接

microsoft / VibeVoice项目地址:https://github.com/microsoft/VibeVoice

本文地址:https://www.tgoos.com/36792