Mini-Omni:能听、能说、能边思考边流式对话的开源多模态大模型

你是否曾经畅想过与AI进行一场如同真人般自然、流畅的语音对话,无需等待它“思考”完毕再“开口”?Mini-Omni 的出现,旨在彻底实现这个愿景。它是一个开源的多模态大语言模型,能够实现端到端的实时语音输入与流式音频输出,真正做到“边想边说”,为下一代语音交互应用提供了强大的开源基础。

截至收录:

Mini-Omni项目stars数:3511

Mini-Omni项目forks数:306

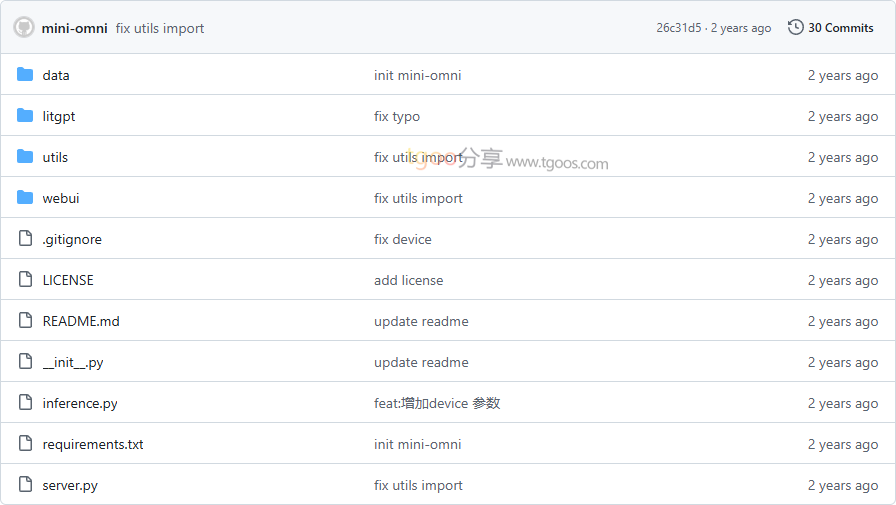

Mini-Omni项目目录截图

Mini-Omni项目核心亮点

- 🗣️ 端到端实时语音对话:直接处理语音输入并生成语音回复,无需依赖额外的语音识别(ASR)或语音合成(TTS)模型,简化了部署流程。

- 🧠 边思考边说话:模型具备流式生成能力,可以在生成文本思考内容的同时,同步输出对应的音频流,大幅降低了对话响应延迟,体验更自然。

- ⚡ 流式音频输出:支持音频的流式生成与播放,用户无需等待整段回复生成完毕即可开始收听,实现了真正的实时交互。

- 🚀 高效批量推理:除了流式交互,还提供“音频到文本”和“音频到音频”的批量推理模式,能够进一步提升处理效率,满足不同场景需求。

Mini-Omni项目快速开始

只需几步,你就能在本地体验与 Mini-Omni 的语音对话:

环境准备与安装:

bash

# 创建并激活 Conda 环境

conda create -n omni python=3.10

conda activate omni

# 克隆项目并安装依赖

git clone https://github.com/gpt-omni/mini-omni.git

cd mini-omni

pip install -r requirements.txt

sudo apt-get install ffmpeg # 安装音频处理工具启动后端服务:

bash

python3 server.py --ip 0.0.0.0 --port 60808启动交互式前端(以Streamlit为例):

bash

pip install PyAudio==0.2.14

# 设置API地址并启动Web界面

API_URL=http://0.0.0.0:60808/chat streamlit run webui/omni_streamlit.py打开浏览器即可开始实时语音对话。

Mini-Omni项目应用场景

- 智能语音助手:构建低延迟、高自然度的个人语音助手,用于信息查询、日程管理或休闲聊天。

- 实时语音客服:为产品或服务提供能“边听边想边回复”的智能客服原型,提升用户体验。

- 交互式语言学习:作为语言陪练工具,与学习者进行实时、流畅的对话练习。

- 无障碍技术:为有视觉或操作障碍的用户提供更高效、自然的语音交互界面。

- 研究与开发:为学术界和工业界研究流式多模态对话、语音语言模型对齐等前沿课题提供了宝贵的开源代码和模型基础。

Mini-Omni项目链接

gpt-omni / mini-omni项目地址:https://github.com/gpt-omni/mini-omni

本文地址:https://www.tgoos.com/36442

声明:本站资源均整理自互联网,版权归原作者所有,仅供学习交流使用,请勿直接商用,若需商用请购买正版授权。因违规使用产生的版权及法律责任由使用者自负。部分资源可能包含水印或引流信息,请自行甄别。若链接失效可联系站长尝试补链。若侵犯您的权益,请邮件(将 # 替换为 @)至 feedback#tgoos.com,我们将及时处理删除。转载请保留原文链接,感谢支持原创。